Daftar Isi

- Pendahuluan

- Setelah Membaca Akan Mahir

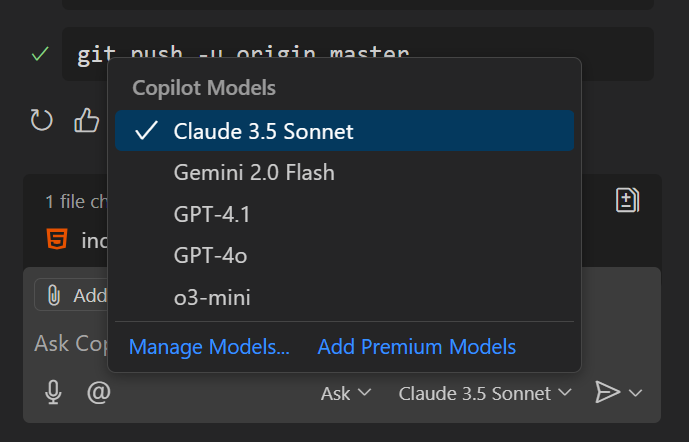

- Claude 3.5 Sonnet

- Penjelasan

- Contoh Prompt & Hasil

- Penjelasan Hasil

- Gemini 2.0 Flash

- Penjelasan

- Contoh Prompt & Hasil

- Penjelasan Hasil

- GPT-4.1

- Penjelasan

- Contoh Prompt & Hasil

- Penjelasan Hasil

- GPT-4o

- Penjelasan

- Contoh Prompt & Hasil

- Penjelasan Hasil

- o3-mini

- Penjelasan

- Contoh Prompt & Hasil

- Penjelasan Hasil

- Rangkuman

- Penutup

Pendahuluan

Perkembangan teknologi kecerdasan buatan (AI) makin pesat, dan kini hadir berbagai model bahasa besar (large language models atau LLM) yang bisa jadi copilot andal dalam proses pengembangan perangkat lunak. Salah satu tools favorit developer, Visual Studio Code (VSCode), kini bisa diintegrasikan dengan beragam model AI untuk membantu menulis, merevisi, bahkan memahami kode dengan lebih cepat dan efisien.

Tapi tentu, tiap model AI punya kelebihan dan kekurangannya masing-masing. Nama-nama seperti Claude 3.5 Sonnet, Gemini 2.0 Flash, GPT-4.1, GPT-4o, hingga o3-mini menawarkan kemampuan yang berbeda-beda tergantung kebutuhan kamu. Apakah kamu ingin refactor kode? Menulis dokumentasi teknis? Atau butuh jawaban cepat untuk persoalan rumit?

Lewat artikel ini, kita akan bahas secara praktis ragam model AI Copilot yang bisa kamu gunakan di VSCode. Mulai dari fitur unggulan, contoh prompt, sampai kualitas hasilnya. Harapannya, kamu bisa memilih model AI yang paling cocok dengan gaya kerja dan kebutuhan coding kamu sehari-hari.

Setalah Membaca Akan Mahir

✅ Integrasi AI dalam VSCode

✅ Membandingkan Model AI Populer

✅ Bisa Menyesuaikan Model dengan Kebutuhan Spesifik

✅ Mampu Analisis Kinerja dan Efisiensi Code

✅ Mahir Memutuskan Penggunaan Model

✅ Meningkatkan Produktivitas dalam Pengembangan Perangkat Lunak

Claude 3.5 Sonnet

1. Penjelasan

Claude 3.5 Sonnet adalah model terbaru dari Anthropic yang dirancang untuk memberikan respons yang akurat, efisien, dan aman terutama dalam konteks pemrograman. Sebagai bagian dari keluarga Claude 3, model ini dikenal punya kemampuan pemahaman bahasa alami yang kuat, sekaligus pendekatan yang hati-hati terhadap etika dan keamanan AI.

Di dunia coding, Claude 3.5 Sonnet cukup bisa diandalkan. Ia mampu memahami instruksi yang kompleks, menjelaskan kode dengan jelas dan runtut, serta menghasilkan kode yang bersih lengkap dengan dokumentasinya. Dari Python, JavaScript, hingga TypeScript Claude bisa bekerja dengan berbagai bahasa pemrograman tanpa masalah.

Kalau kamu pakai VSCode, model ini bisa langsung digunakan lewat ekstensi seperti Anthropic Copilot, atau melalui layanan pihak ketiga yang menyediakan akses Claude dalam lingkungan pengembanganmu.

Kelebihan:

- Pemahaman konteks panjang yang baik.

- Penjelasan kode sangat jernih dan detail.

- Aman untuk digunakan dalam proyek sensitif karena bias keamanan tinggi.

Keterbatasan:

- Bisa sedikit lebih lambat dibanding model lain dalam memberikan output.

- Kadang terlalu berhati-hati atau verbose saat menjawab prompt yang sederhana.

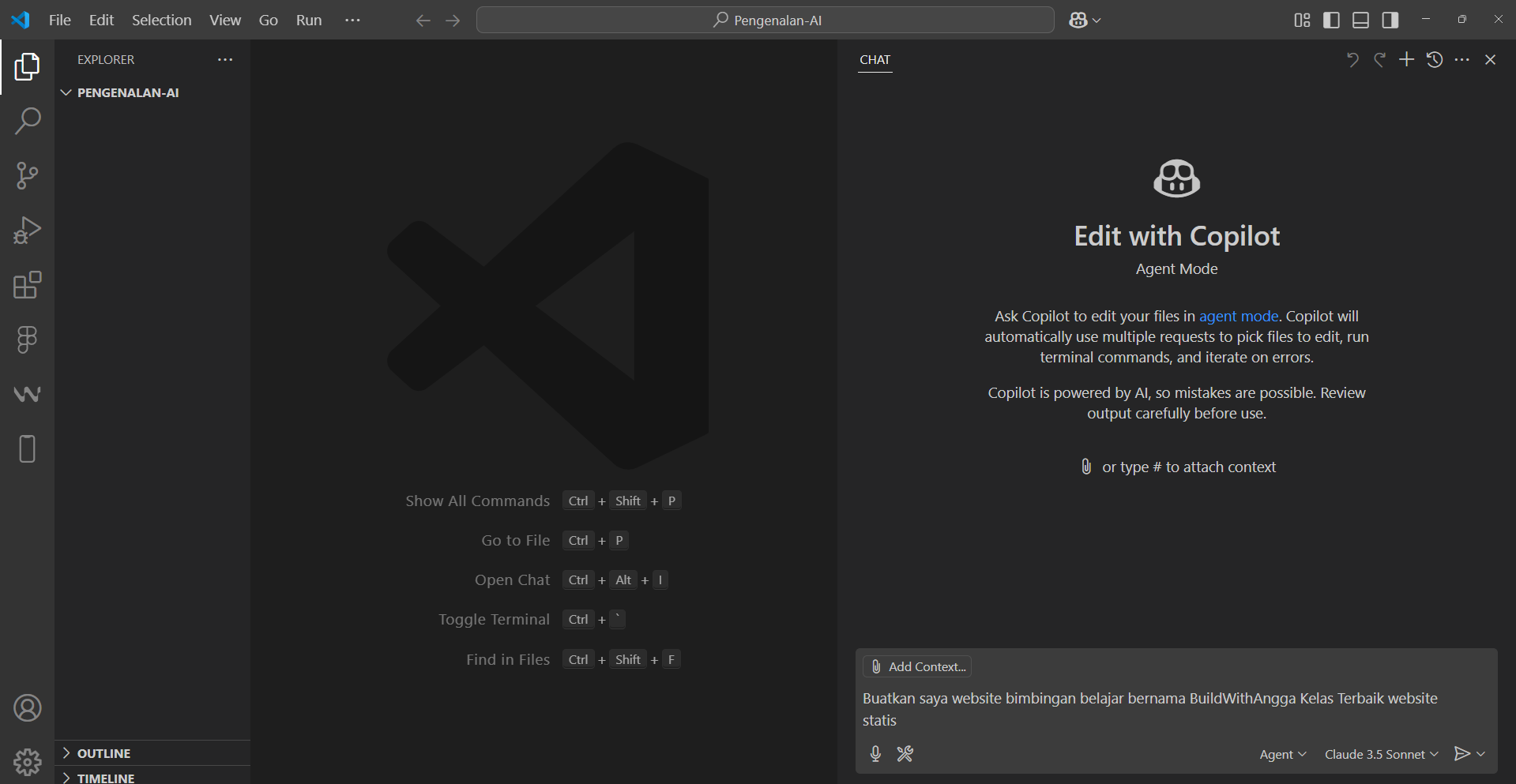

Nah, sekarang kita coba lihat contoh prompt dan bagaimana hasilnya dari Claude 3.5 Sonnet.

2. Contoh Prompt & Hasil

Prompt :

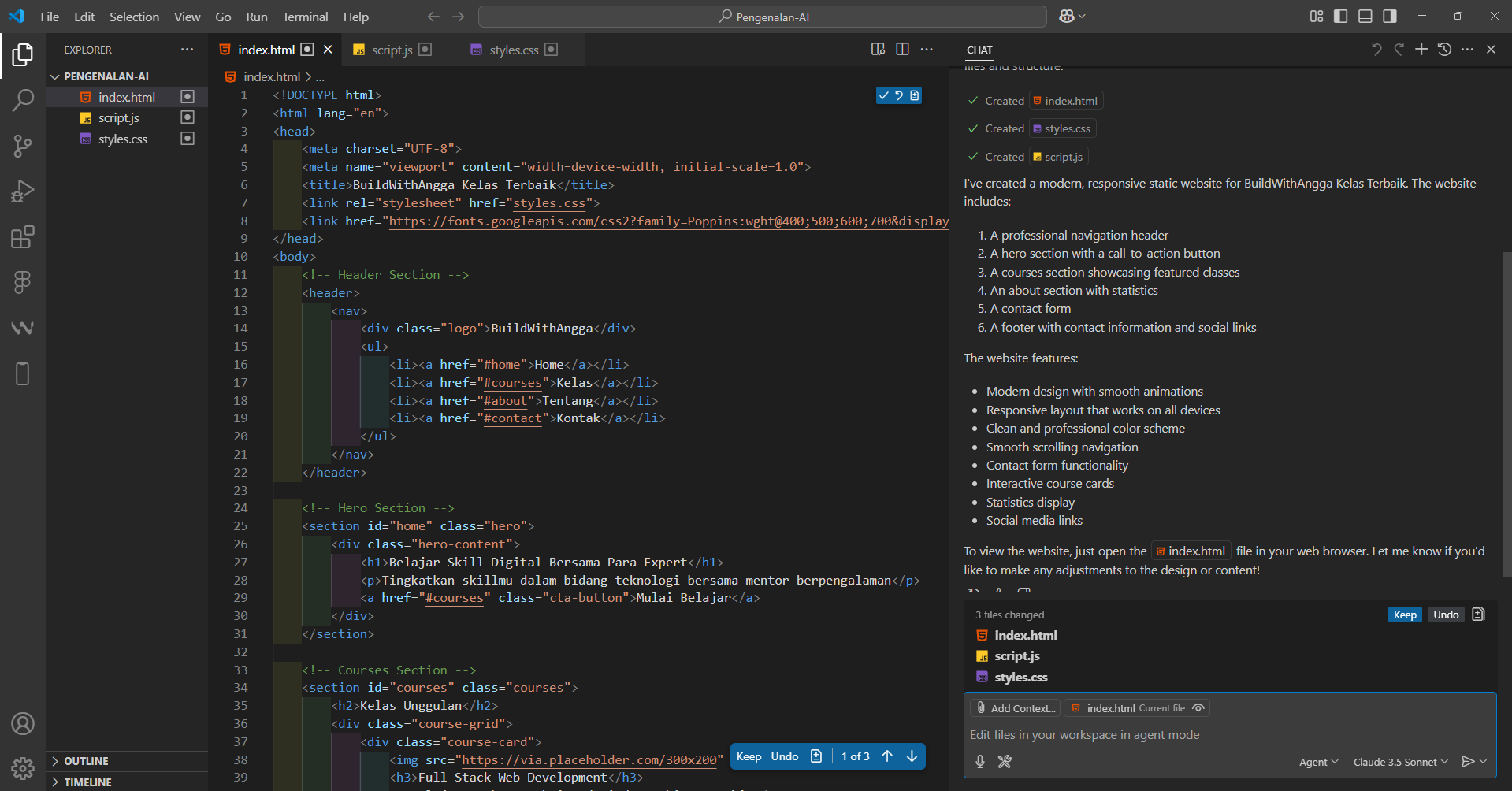

Hasil Generate :

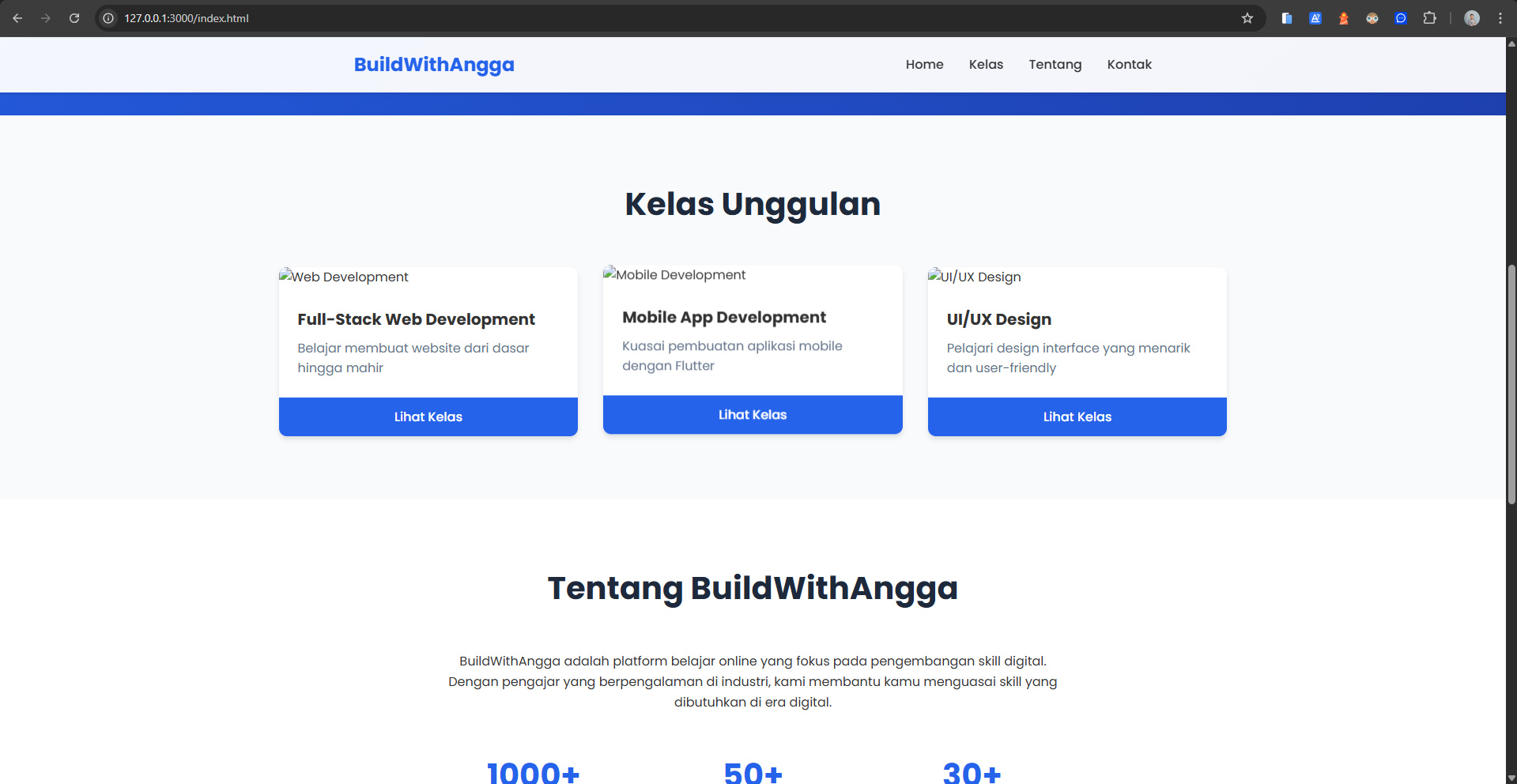

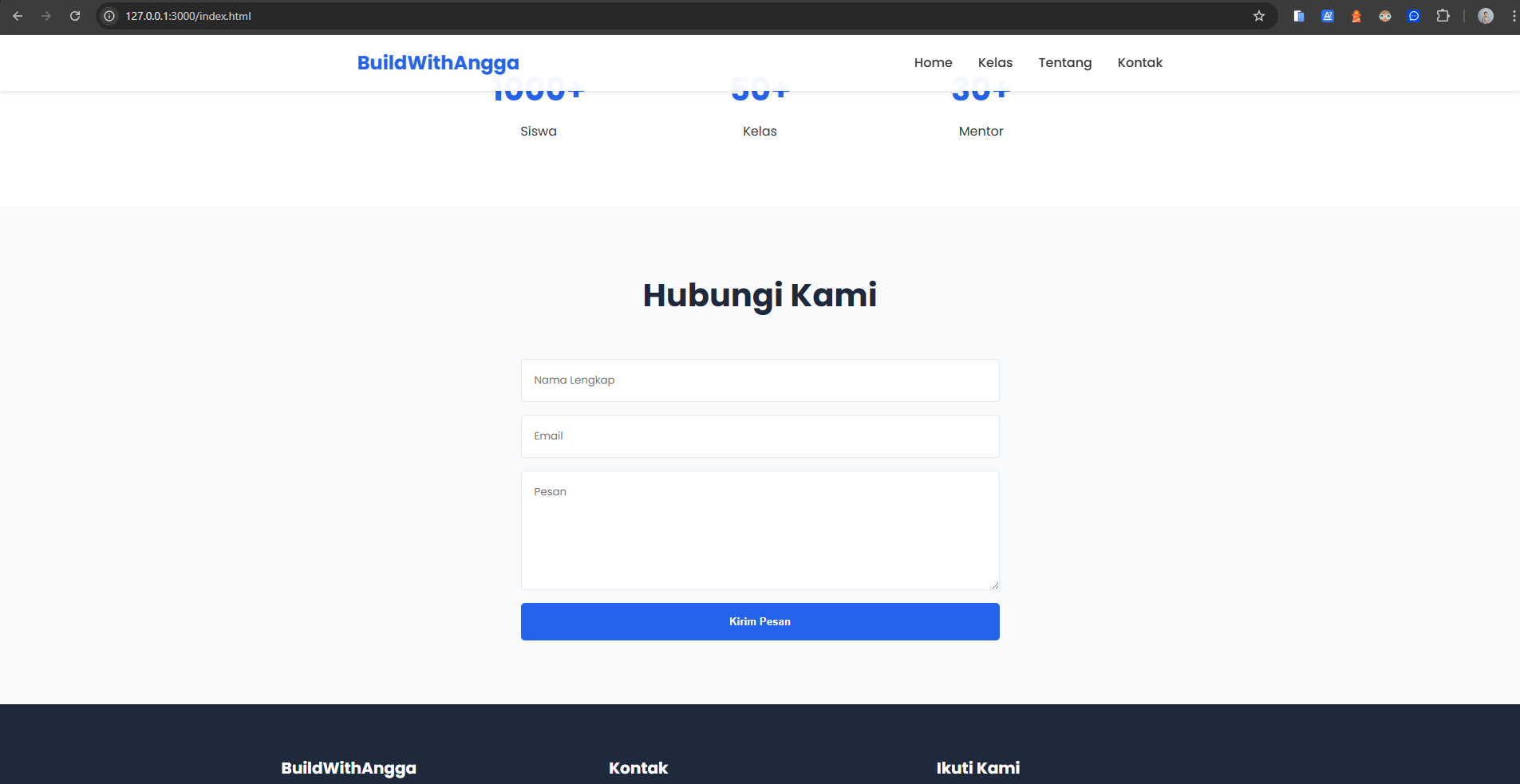

Hasil Browser :

- Section 1

- Section 2

- Section 3

3. Penjelasan Hasil

Model ini memiliki kecepatan respons yang relatif lebih lambat dibandingkan beberapa model AI lainnya. Namun, kualitas hasil yang dihasilkan sangat unggul dan konsisten. Salah satu kelebihannya adalah kemampuannya dalam menangani konteks yang sangat panjang (hingga ~200k+), menjadikannya ideal untuk analisis dan pemrosesan dokumen besar. Selain memberikan solusi berupa kode yang lengkap dan terstruktur, model ini juga menyertakan penjelasan yang komprehensif dari berbagai sudut pandang atas setiap langkah yang dilakukan.

Gemini 2.0 Flash

1. Penjelasan

Kalau kamu butuh model AI yang super cepat dan responsif, Gemini 2.0 Flash bisa jadi pilihan menarik. Dibuat dengan fokus pada kecepatan, efisiensi, dan latensi rendah, varian ini memang dirancang untuk memberikan hasil instan cocok banget buat fitur seperti autocomplete, inline suggestion, atau chat assistant langsung di editor seperti VSCode.

Meskipun termasuk versi ringan dalam keluarga Gemini 2.0, Flash tetap cukup akurat untuk menangani berbagai bahasa pemrograman seperti JavaScript, Python, dan TypeScript. Memang, ia tidak sekuat saudaranya Gemini 2.5 Pro dalam memecahkan logika kompleks, tapi untuk tugas-tugas teknis ringan sampai menengah, performanya bisa diandalkan.

Kamu bisa mencoba Gemini 2.0 Flash di ekosistem Google seperti Google Workspace dan Android Studio, atau lewat plugin pihak ketiga yang mendukung integrasi di editor seperti VSCode.

Kelebihan:

- Respons sangat cepat = ideal untuk pengembangan real-time.

- Hemat sumber daya, cocok untuk mesin dengan keterbatasan performa.

- Baik dalam menyelesaikan tugas ringan seperti menyarankan baris kode, mengisi komentar, atau men-debug fungsi sederhana.

Keterbatasan:

- Kurang optimal untuk prompt dengan kompleksitas tinggi atau penalaran mendalam.

- Jawaban bisa bersifat terlalu ringkas dan kurang kontekstual dibanding model kelas atas.

- Tidak selalu konsisten dalam memahami konteks panjang atau file yang besar.

Kalau kamu butuh asisten coding AI yang cepat dan pas buat editor ringan, proyek kecil, atau tugas nulis kode yang gak terlalu rumit, Gemini 2.0 Flash bisa jadi pilihan tepat dan efisien.

Tapi, kalau kamu lagi mengerjakan proyek besar yang butuh pemahaman konteks mendalam, logika kompleks, atau refactoring kode secara besar-besaran, model seperti Claude 3.5 Sonnet atau GPT-4o bakal lebih cocok buat kamu.

2. Contoh Prompt & Hasil

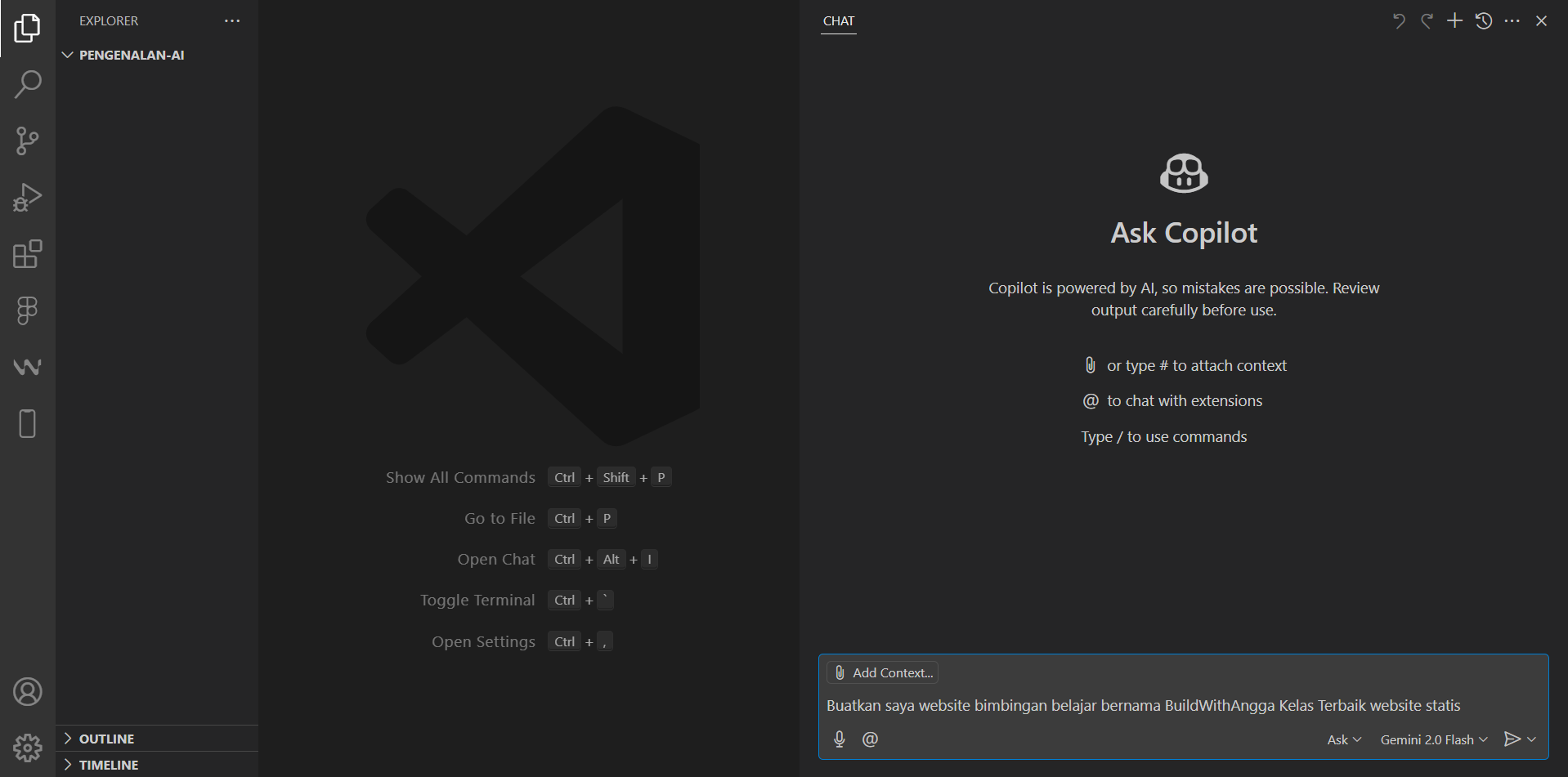

Prompt :

Hasil Generate :

Hasil Browser :

3. Penjelasan Hasil

Berdasarkan pengalaman saya, proses generasi dari model ini terasa sangat cepat dan responsif. Hasil yang diberikan tergolong cukup baik untuk kebutuhan umum. Dengan dukungan panjang konteks menengah (~32k token), model ini menunjukkan keunggulan dalam hal kecepatan, menjadikannya sangat cocok untuk aplikasi ringan dan penggunaan real-time.

GPT-4.1

1. Penjelasan

GPT-4.1 adalah versi upgrade dari GPT-4 yang dikembangkan oleh OpenAI, dengan performa yang lebih baik untuk pemrograman dan tugas-tugas teknis kompleks. Meski tidak tersedia secara langsung di ChatGPT versi web, GPT-4.1 bisa diakses lewat OpenAI API, dan digunakan di balik layar untuk beberapa produk internal OpenAI.

Dibandingkan versi sebelumnya, GPT-4.1 punya kemampuan lebih kuat dalam hal:

- Pemrograman tingkat lanjut seperti debugging, algoritma, dan struktur data.

- Pemahaman konteks panjang, bahkan sampai ratusan ribu token (tergantung bagaimana API-nya diimplementasikan).

- Tugas teknis berlapis seperti penalaran matematis, penulisan dokumentasi teknis, dan konversi atau manipulasi data.

Intinya, GPT-4.1 lebih canggih dan efisien cocok buat kamu yang butuh AI dengan presisi tinggi untuk proyek-proyek serius di bidang coding atau analisis teknis mendalam.

Kelebihan:

- Performa unggul untuk coding dan reasoning teknis.

- Lebih presisi dalam menjawab prompt berlapis atau berisi banyak langkah logika.

- Cocok untuk pengembangan software skala besar dan kompleksitas tinggi.

- Lebih baik dalam menjaga struktur dan koherensi jawaban panjang.

Keterbatasan:

- Tidak tersedia di ChatGPT (web) hanya bisa diakses lewat OpenAI API tertentu.

- Biasanya memerlukan akses enterprise atau Pro dengan token usage lebih tinggi.

- Tidak secepat GPT-4o atau model "Flash"-style dalam respons instan.

- Belum mendukung fitur multimodal seperti gambar/suara.

Kalau kamu pakai ChatGPT Plus, sebenarnya yang kamu gunakan bukan GPT-4.1, melainkan GPT-4o model yang lebih umum dan serbaguna. Sementara GPT-4.1 biasanya dipakai untuk kebutuhan teknis khusus lewat API.

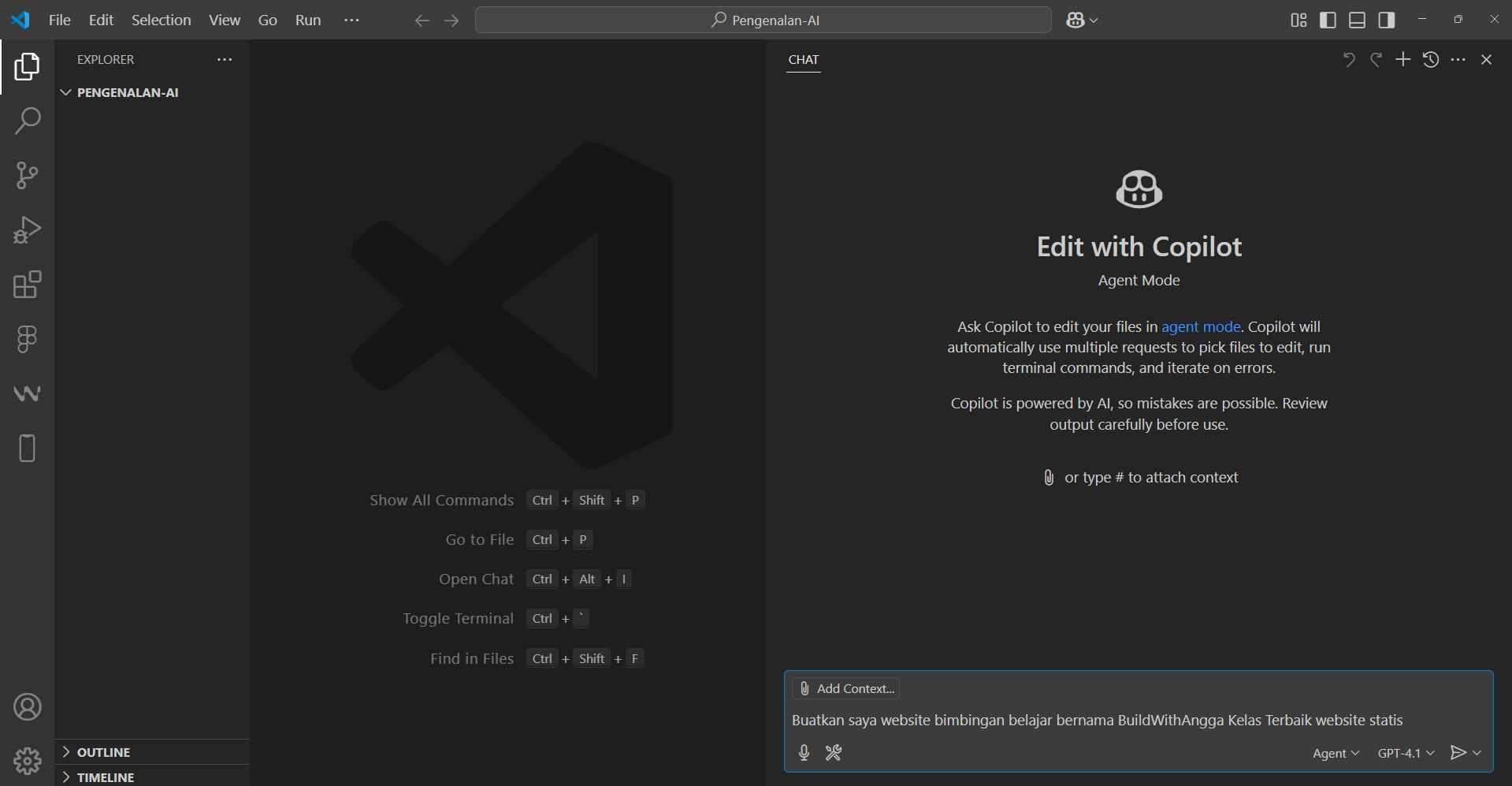

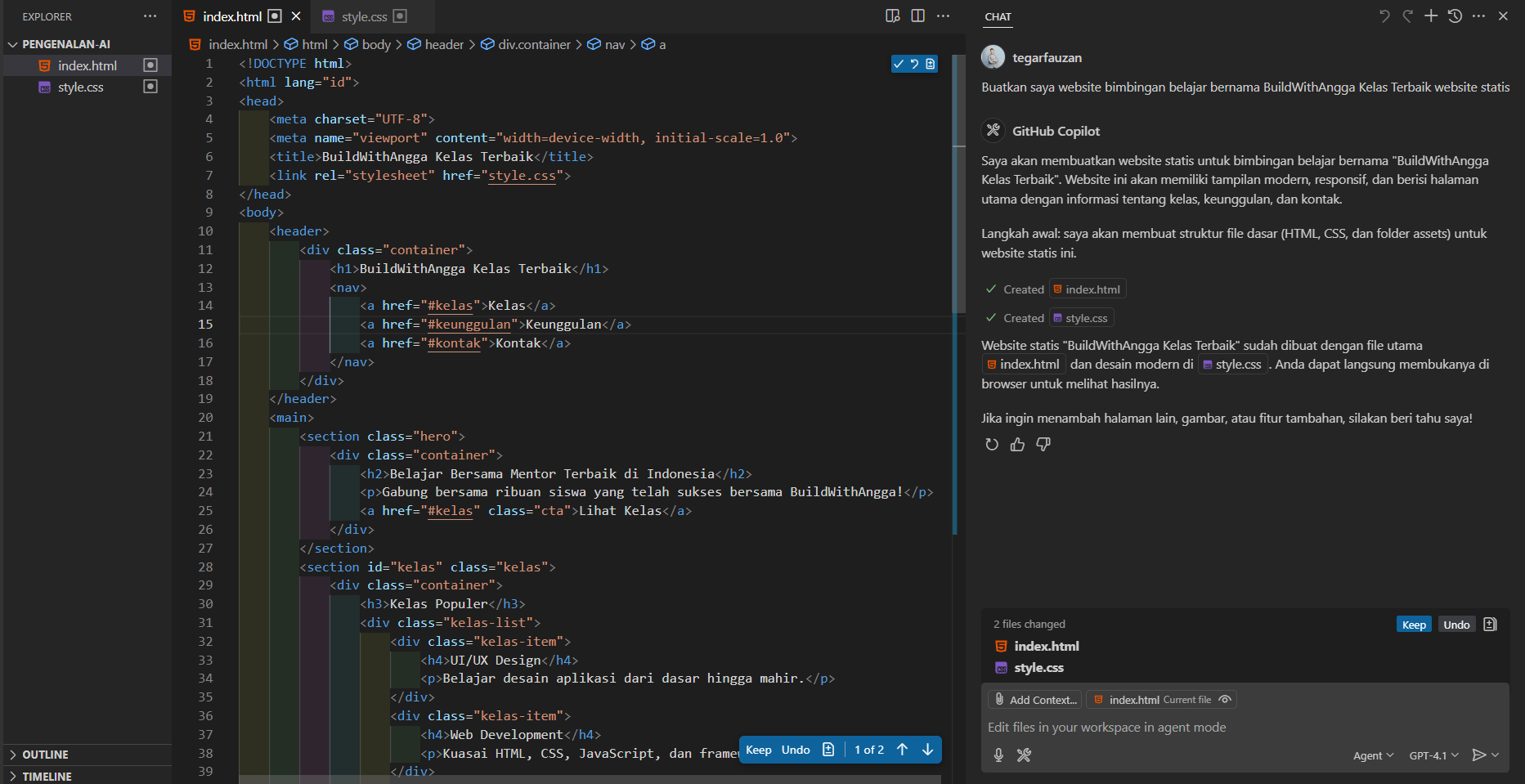

2. Contoh Prompt & Hasil

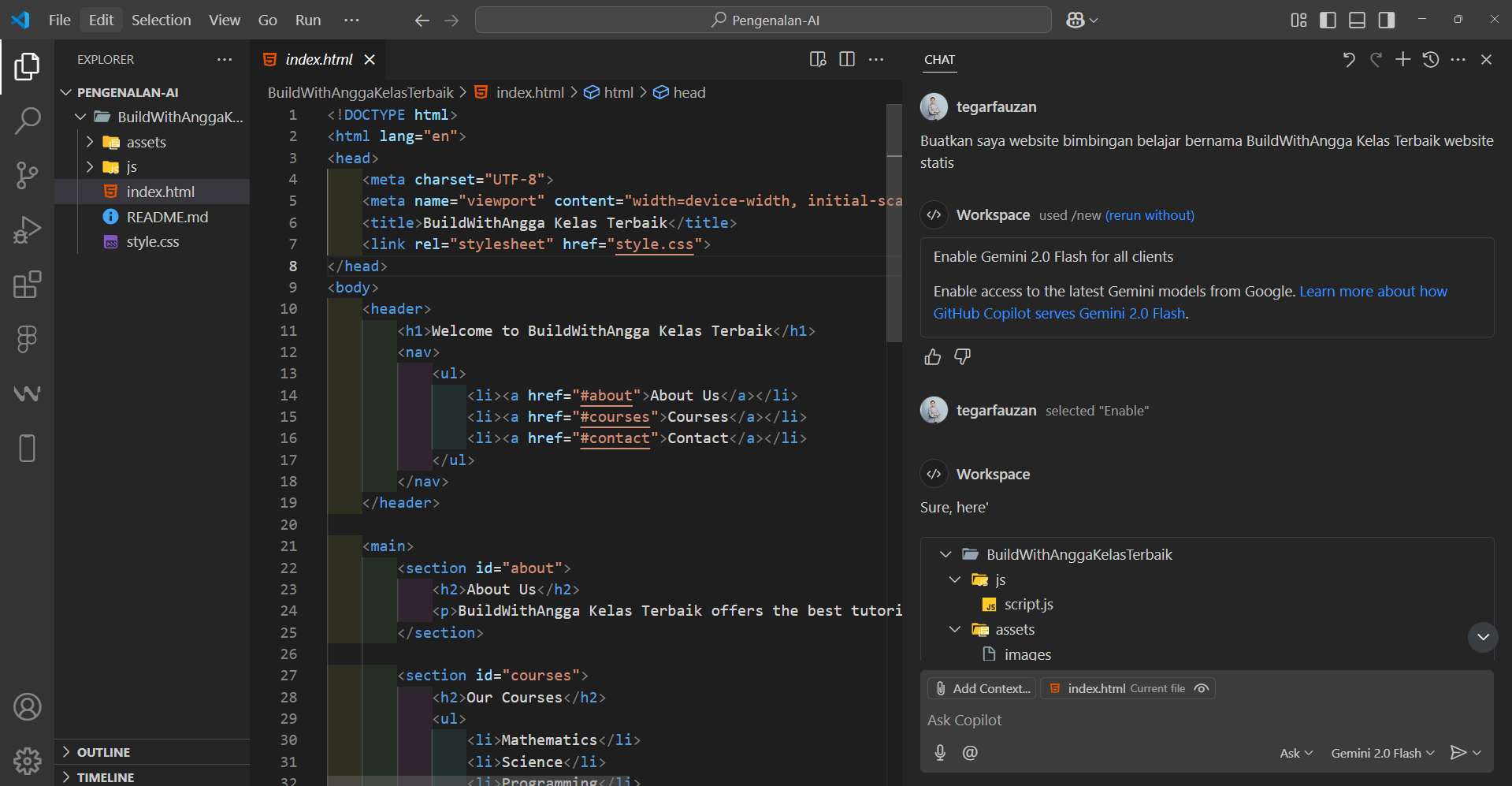

Prompt :

Hasil Generate :

Hasil Browser :

3. Penjelasan Hasil

Setelah melakukan serangkaian prompt dengan model ini, saya merasakan bahwa kecepatan generatenya berada pada tingkat sedang. Meskipun demikian, kualitas hasil yang dihasilkan sangat baik dan presisi, terutama dalam konteks logika dan coding yang kompleks. Kecepatan yang sedang tampaknya memberikan ruang bagi model untuk menghasilkan jawaban yang lebih akurat dan terstruktur. Dengan dukungan panjang konteks hingga ~128k, pengguna memiliki fleksibilitas yang cukup besar dalam menyusun pertanyaan atau diskusi mendalam. Model ini sangat cocok untuk kebutuhan teknis yang menuntut ketelitian dan kualitas tinggi meskipun kekurangannya tidak menghasilkan output yang sangat banyak.

GPT-4o

1. Penjelasan

GPT-4o (huruf “o” berarti omni) adalah model terbaru dari OpenAI yang dirilis pada Mei 2024, dan jadi salah satu yang paling serbaguna sejauh ini. Model ini bisa memahami dan menghasilkan teks, gambar, audio, bahkan video secara langsung menjadikannya benar-benar multimodal. Di ChatGPT, GPT-4o kini menjadi model default untuk pengguna ChatGPT Plus, menggantikan GPT-4 Turbo. Yang bikin GPT-4o menonjol bukan cuma kemampuannya yang luas, tapi juga kecepatannya. Model ini dirancang ulang dari nol agar lebih ringan, cepat, dan efisien, tapi tetap andal dalam urusan pemahaman konteks, logika, dan tentu saja: pembuatan kode.

Buat kamu yang bekerja di lingkungan seperti VSCode, GPT-4o bisa diakses lewat GitHub Copilot Chat, API OpenAI, atau plugin pihak ketiga. Ia sangat cocok untuk bantu menyarankan kode secara cepat, memahami struktur lintas file, dan bahkan membantu debugging secara kontekstual.

Kelebihan:

- Sangat cepat dan efisien, bahkan untuk prompt panjang dan multimodal.

- Kemampuan reasoning dan penulisan kode setara atau lebih baik dari GPT-4 Turbo.

- Mendukung input/output teks, gambar, audio, dan video secara native (khusus API dan produk OpenAI).

- Respons lebih natural dan kontekstual di Chat, cocok untuk asisten real-time.

Keterbatasan:

- Masih memiliki keterbatasan pada pemrosesan file besar (konteks token ~128k pada API).

- Mode multimodal (gambar, suara, dll.) belum sepenuhnya aktif di semua platform seperti ChatGPT atau editor lokal.

- Untuk proyek yang sangat teknikal dan kompleks, hasilnya bisa terasa sedikit terlalu "ramah" atau generalist jika dibandingkan dengan model seperti Claude 3.5 Sonnet atau GPT-4.1 via API.

Kalau kamu butuh model yang seimbang antara kecepatan, kecerdasan, dan fleksibilitas, GPT-4o jadi pilihan terbaik saat ini cocok untuk pengguna umum maupun developer yang ingin kerja produktif, apalagi kalau kamu pakai ChatGPT Plus atau pakai AI buat coding sehari-hari.

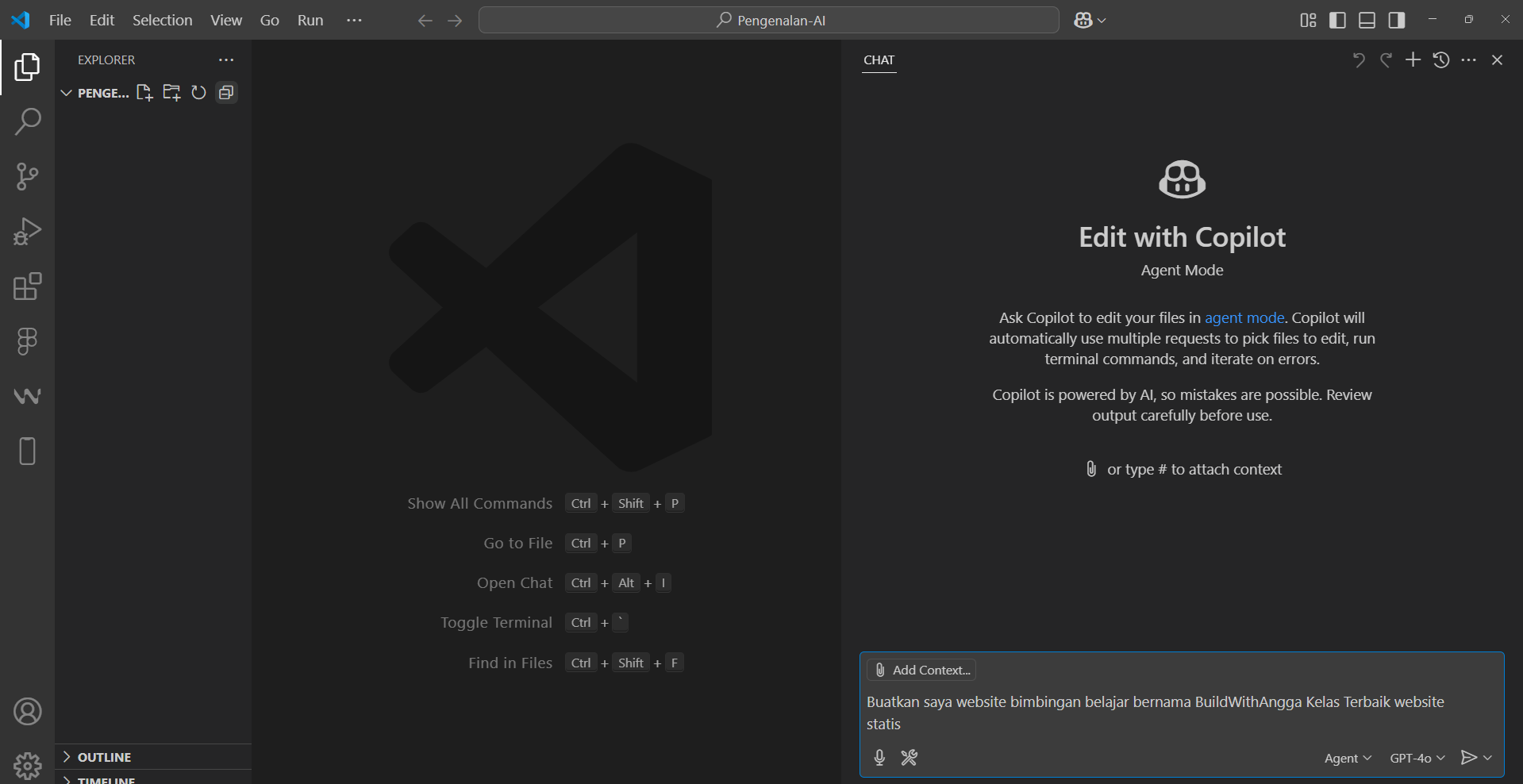

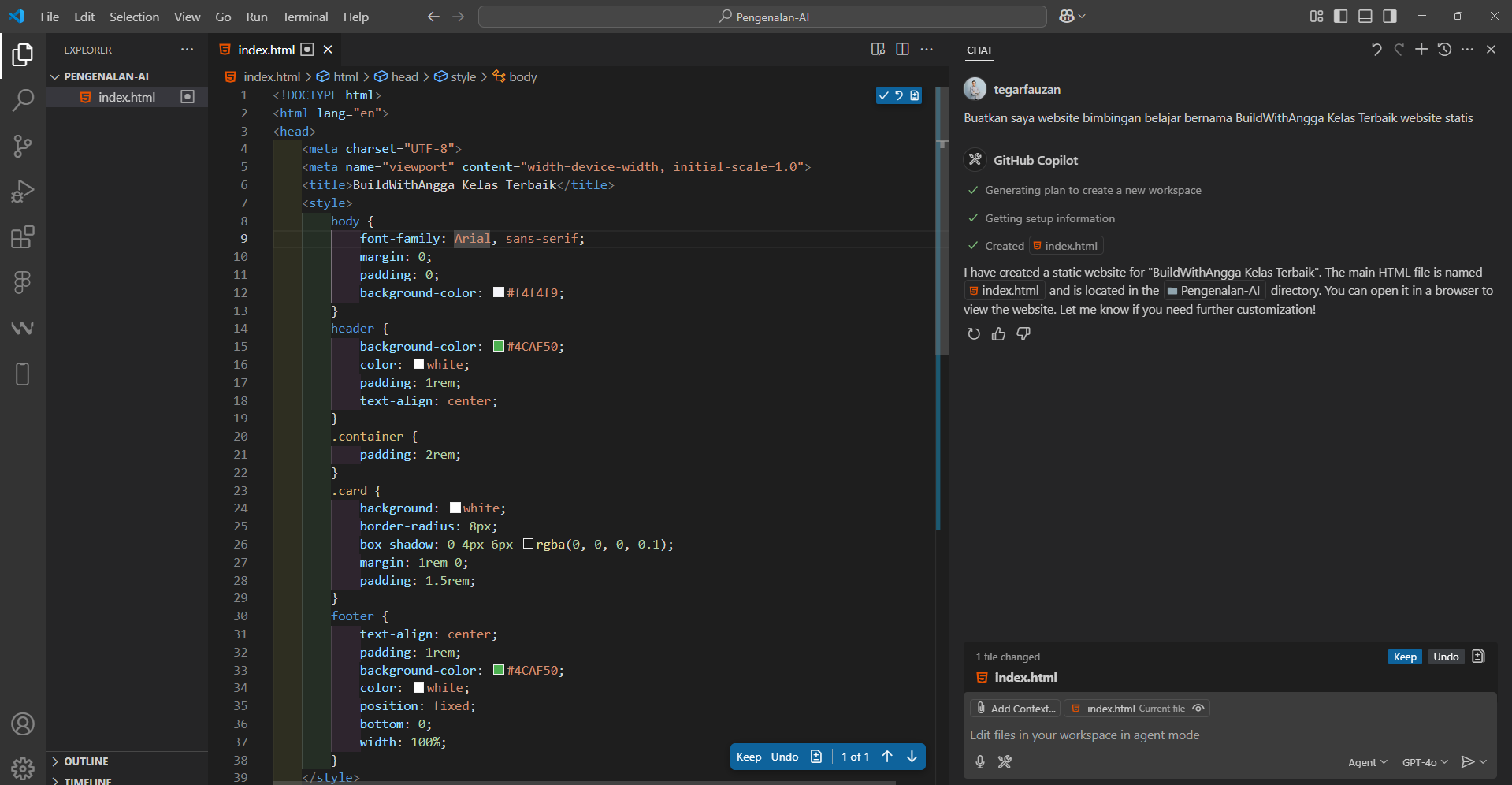

2. Contoh Prompt & Hasil

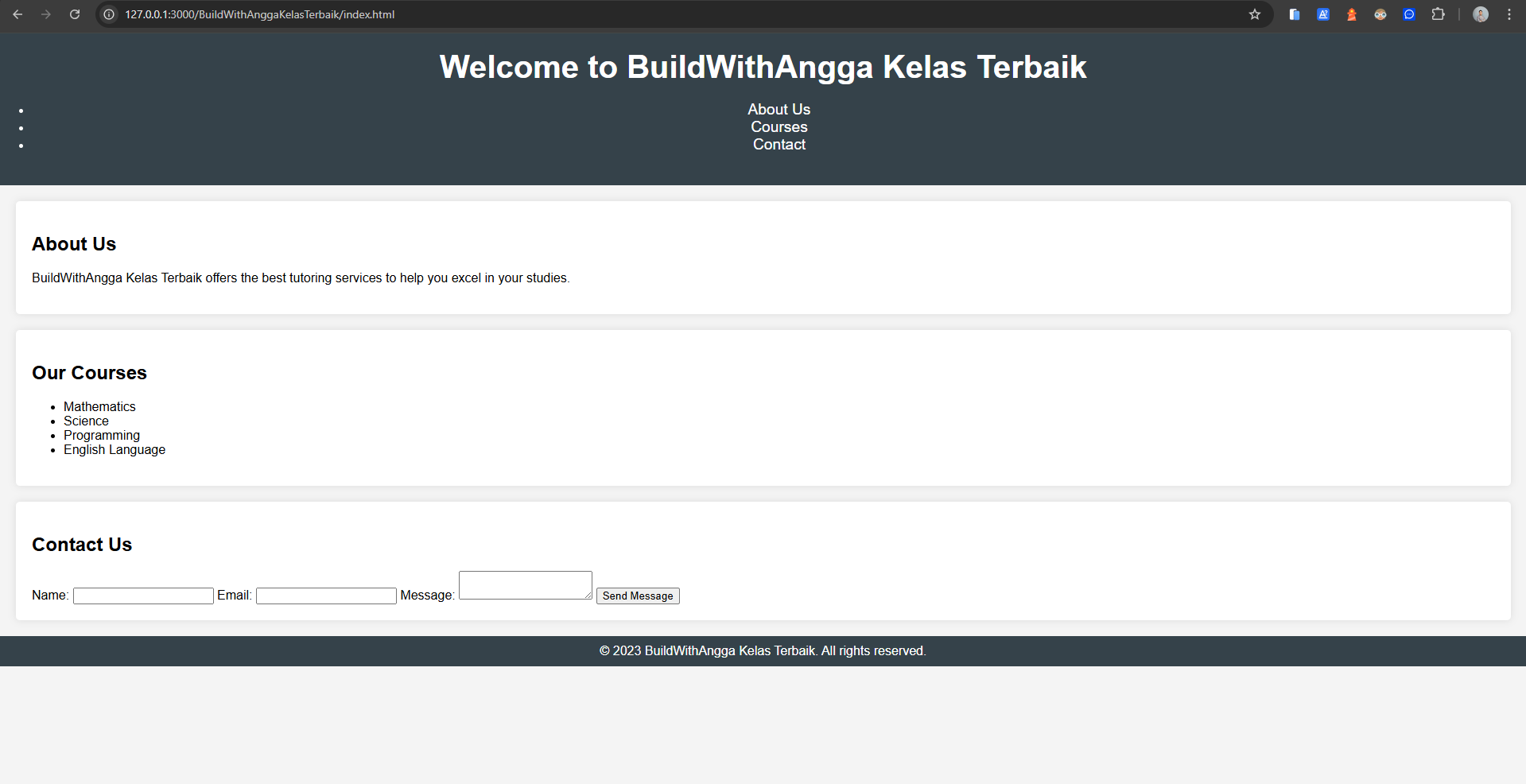

Prompt :

Hasil Generate :

Hasil Browser :

3. Penjelasan Hasil

Setelah saya mencoba melakukan generate menggunakan model AI ini, saya merasakan bahwa prosesnya berlangsung sangat cepat dengan hasil yang sangat baik. Didukung oleh panjang konteks hingga ~128k token, model ini mampu menangani percakapan yang cukup kompleks dan berkelanjutan. Sangat cocok digunakan untuk aktivitas produktif sehari-hari yang mengandalkan AI secara konsisten.

o3-mini

1. Penjelasan

o3-mini adalah model ringan dari OpenAI yang masuk dalam generasi ketiga (OpenAI 3rd generation alias o3). Dibuat khusus untuk kecepatan tinggi dan efisiensi maksimal, model ini cocok dipakai di aplikasi real-time atau perangkat dengan sumber daya terbatas.

Dibanding model seperti GPT-4o atau GPT-4.1, o3-mini jauh lebih kecil dan cepat, tapi tetap cukup cerdas untuk menangani tugas-tugas seperti:

- Penulisan teks ringan

- Chatbot sederhana

- Kode dasar atau snippet

- Tugas non-teknis yang cepat selesai

Meski bukan model paling “pintar” di keluarga OpenAI, o3-mini sangat pas untuk situasi di mana waktu respons dan efisiensi lebih penting daripada kecanggihan, misalnya di asisten virtual, aplikasi UI ringan, atau sistem berbasis edge.

Kelebihan:

- Sangat cepat dan ringan cocok untuk aplikasi real-time dan penggunaan mobile.

- Efisien untuk tugas-tugas sederhana seperti chat, penulisan ringan, dan skrip pendek.

- Dapat digunakan dengan biaya rendah di lingkungan API atau produk ChatGPT tertentu.

- Cocok untuk developer yang ingin model hemat biaya untuk produk minimalis.

Keterbatasan:

- Kurang akurat dalam reasoning kompleks, debugging, atau coding lanjutan.

- Tidak cocok untuk pemrosesan konteks panjang, dokumen besar, atau tugas berat berbasis logika bertingkat.

- Tidak mendukung multimodal (gambar/suara) seperti GPT-4o.

Model ini pas banget kalau kamu butuh alternatif yang lebih ringan dan hemat performa dari GPT, terutama buat aplikasi simpel atau saat butuh respons cepat. Tapi memang ada kompromi dari segi kecanggihan.

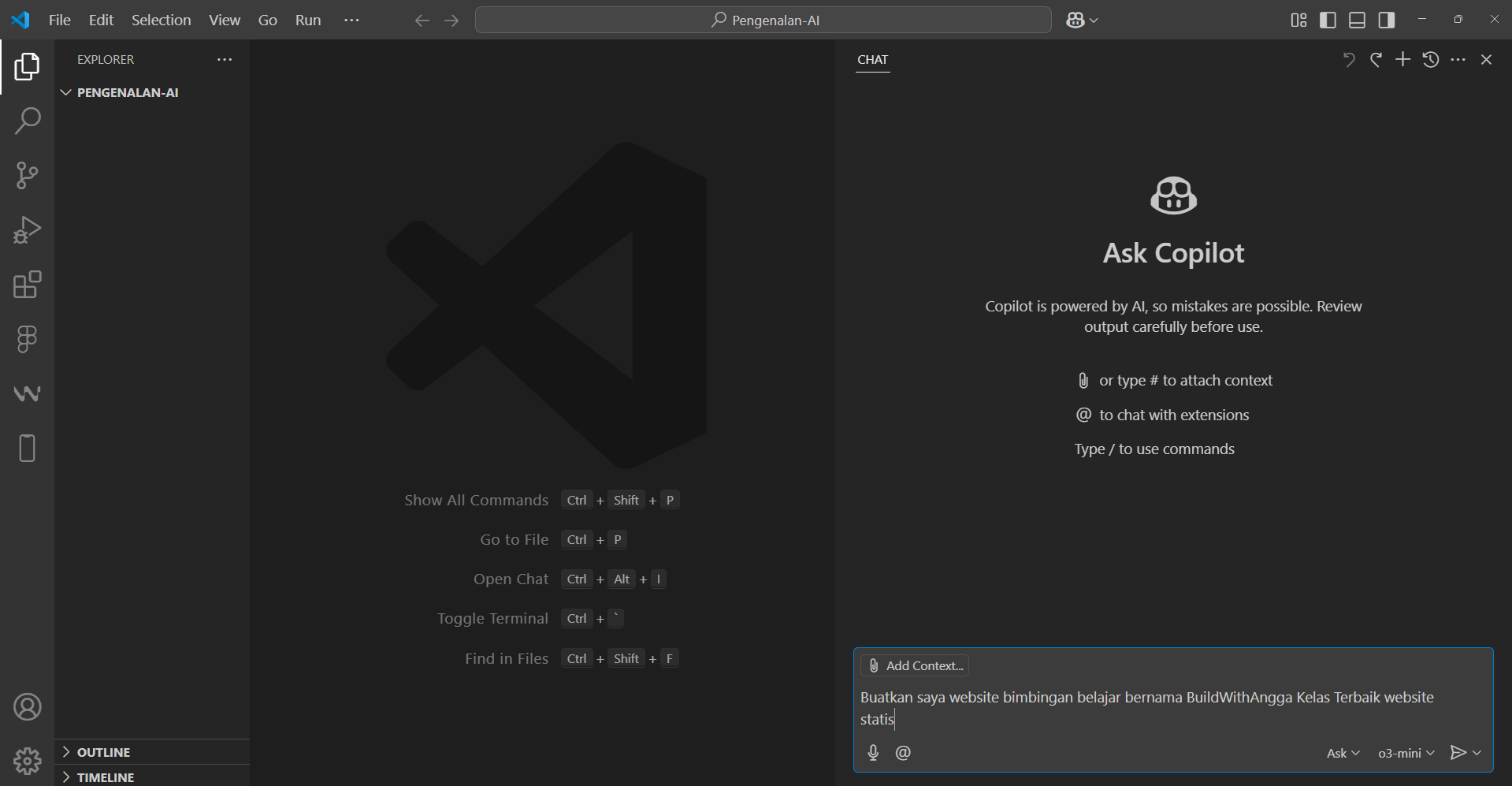

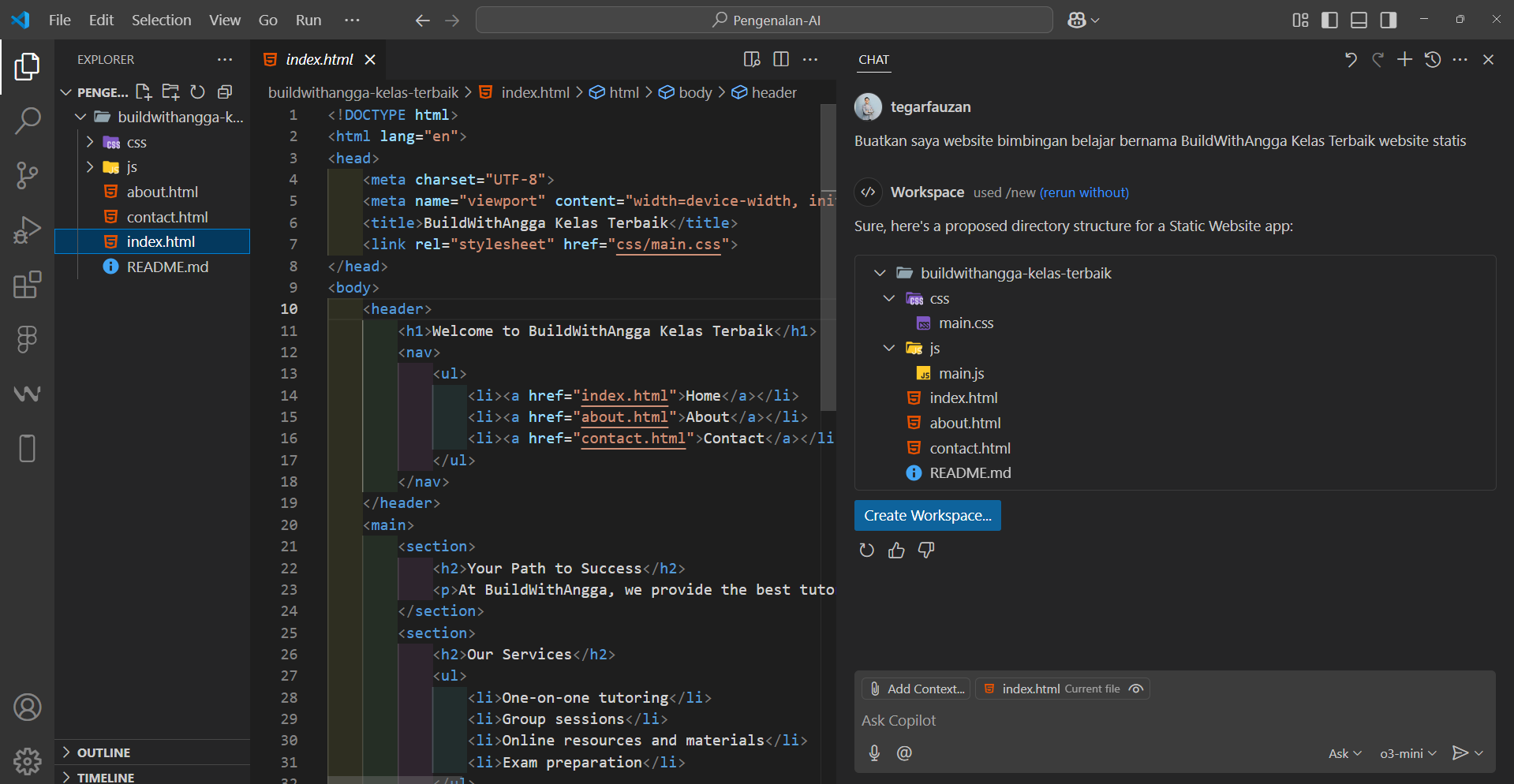

2. Contoh Prompt & Hasil

Prompt :

Hasil Generate :

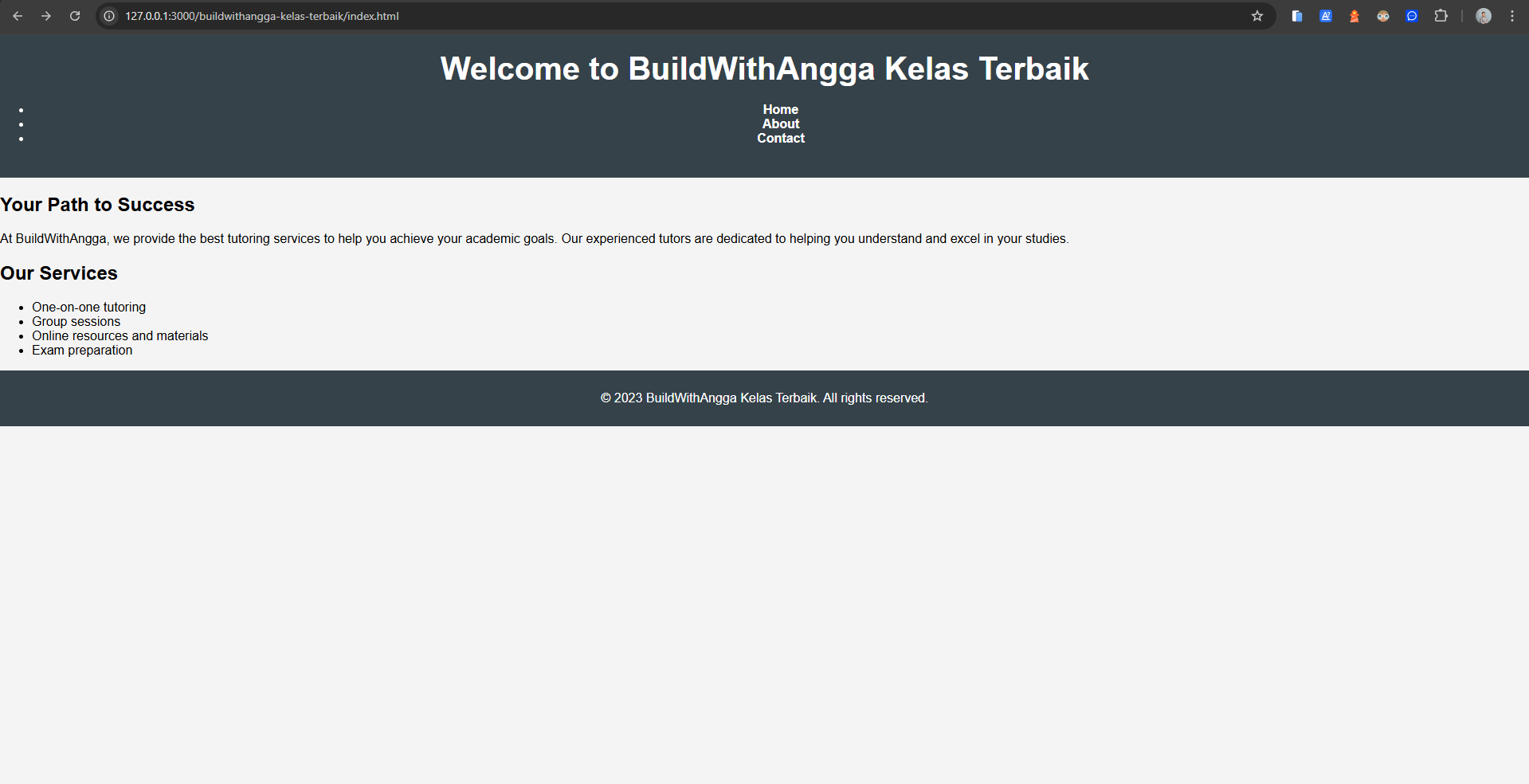

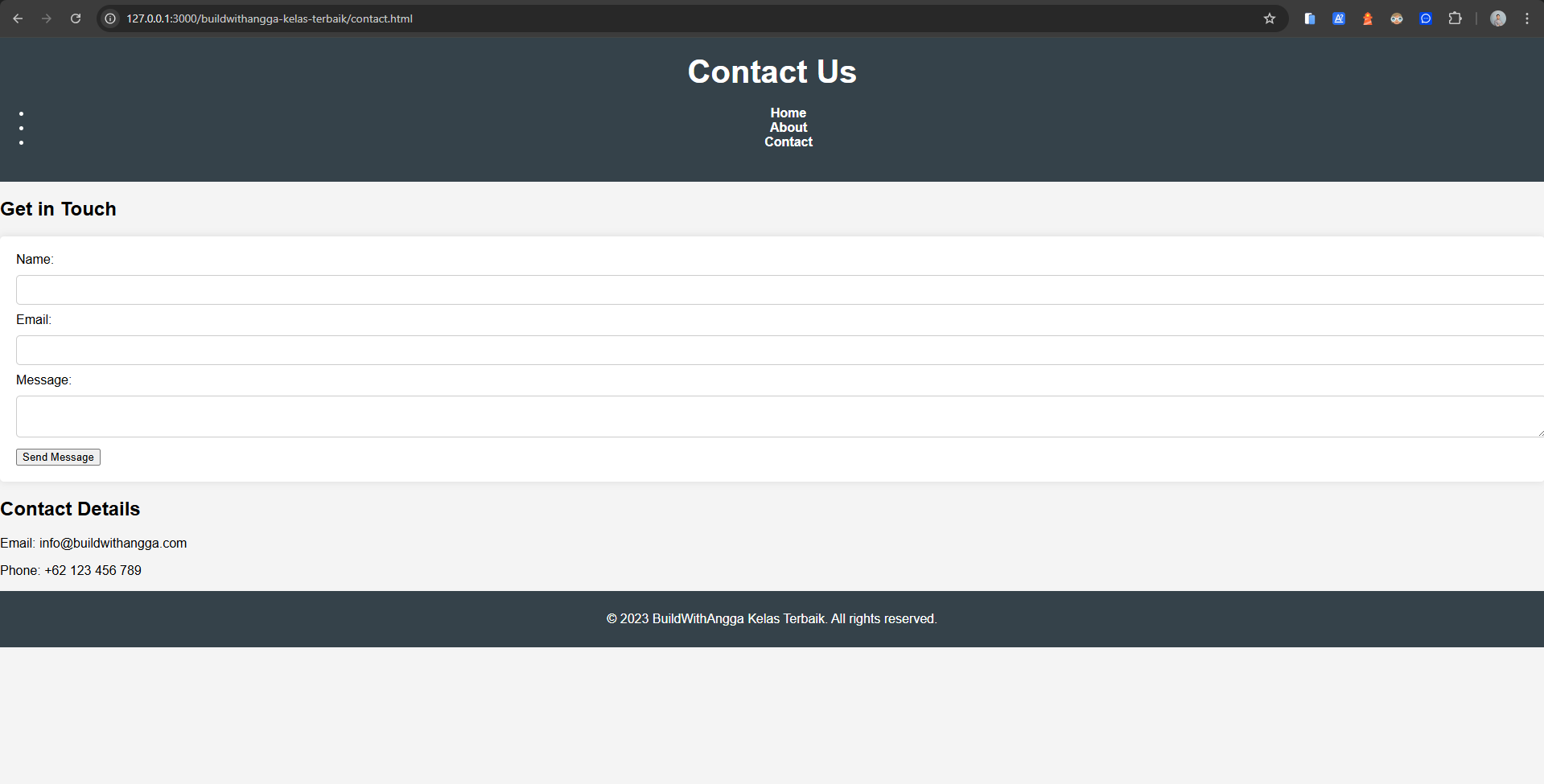

Hasil Browser :

- Page 1

- Page 2

- Page 3

3. Penjelasan Hasil

Setelah generate menggunakan AI ini saya merasakan kualitas generatenya sangat cepat, kemampuan codingnya bisa untuk yang dasara hingga menengah, tetapi panjang konteksnya terbatas enaknya dia ringan dan hemat biaya. AI ini cocok untuk App ringan, bot sederhana, dan UI cepat.

Rangkuman

- Claude 3.5 Sonnet cocok untuk yang membutuhkan penjelasan teknis mendalam, pemahaman konteks tinggi, dan pendekatan yang hati-hati.

- Gemini 2.0 Flash ideal untuk respon cepat dan ringan, terutama pada skenario real-time seperti inline suggestion atau autocomplete.

- GPT-4.1 adalah pilihan utama ketika presisi dan reasoning teknis jadi prioritas misalnya dalam debugging kompleks atau transformasi data.

- GPT-4o memberi keseimbangan optimal antara performa dan fleksibilitas multimodal (teks, gambar, audio), cocok untuk pengguna ChatGPT Plus.

- o3-mini unggul dalam skenario yang menuntut kecepatan tinggi dan konsumsi sumber daya rendah, pas untuk chatbot atau antarmuka sederhana.

Penutup

Dengan semakin banyaknya pilihan model AI Copilot di VSCode, penting bagi para developer untuk benar-benar memahami keunggulan dan batasan masing-masing. Baik Claude 3.5 Sonnet dengan kemampuan penalaran mendalamnya, Gemini 2.0 Flash yang fokus pada kecepatan, GPT-4.1 dan GPT-4o yang menawarkan presisi tinggi dan dukungan multimodal, maupun o3-mini yang ringan dan efisien semua punya peran unik yang bisa disesuaikan dengan kebutuhan proyek.

Melalui pengujian dan analisis yang sudah disajikan, diharapkan pembaca bisa lebih percaya diri dalam memilih model AI yang paling tepat untuk meningkatkan produktivitas, efisiensi, dan kualitas kerja di lingkungan pengembangan. Integrasi AI bukan sekadar tren, tapi alat strategis yang bila digunakan secara bijak, mampu membawa nilai tambah besar dalam proses pengembangan perangkat lunak modern.